Sommaire

Résumer ou partager cet article :

Non, la réponse n’est pas « Patapouf », votre fidèle compagnon. Certes, il est partout : sur votre fond d’écran, dans votre mot de passe « Patapouf-Du-10 » à la sécurité douteuse, et c’est même Claude qui vous a aidé à le baptiser un jour de panne d’inspiration. Mais au-delà de votre affection canine, ces trois éléments partagent une réalité mathématique bien plus profonde, posée par un seul homme, il y a près de 80 ans.

Son nom : Claude Shannon. Il a inventé le bit, défini mathématiquement ce qu’est une information, et rendu possible à peu près tout ce que vous faites quand vous allumez un écran. L’IA que vous utilisez peut-être tous les jours porte son prénom en hommage. Et sans le savoir, vous exploitez ses équations à chaque photo compressée, à chaque mot de passe tapé, à chaque prompt envoyé.

Claude Shannon, le génie qui a inventé votre époque

Claude Elwood Shannon (1916-2001) est l’homme que tous vos fournisseurs d’outils numériques connaissent, mais que personne ne vous a jamais présenté. Ingénieur, mathématicien, professeur au MIT, passé par les Bell Labs pendant la Seconde Guerre mondiale, il publie en 1948, dans le Bell System Technical Journal, un article de 55 pages intitulé A Mathematical Theory of Communication. Cet article pose, à lui seul, les fondations de l’intégralité de l’ère numérique.

C’est dans ce papier que Shannon introduit le mot bit (pour binary digit) comme unité de mesure de l’information. Il démontre qu’on peut transmettre n’importe quel message, quel que soit son support (voix, texte, signal électrique, onde radio), en le codant en 0 et en 1. Mieux : il pose une équation qui permet de mesurer la quantité d’information contenue dans un message. C’est ce qu’il appelle l’entropie, en référence à la thermodynamique. Plus un message est imprévisible, plus il contient d’informations. Plus il est prévisible, moins il en contient. Ses successeurs étendront ce cadre, dans les décennies suivantes, à la compression d’image, au codage audio et à la vidéo numérique.

Le principe est plus intuitif qu’il n’y paraît. Quand le PSG bat une équipe de National 3, personne ne lève la tête. Le résultat était écrit d’avance : zéro surprise, zéro information. Quand il perd, les notifications explosent. Le résultat était improbable, donc il contient énormément d’informations. L’entropie de Shannon mesure précisément ça : la surprise que transporte un message. Et comme on va le voir, cette idée simple se retrouve dans votre mot de passe, vos images et votre IA.

Votre mot de passe : l’entropie comme mesure du chaos

Revenons à « Patapouf-Du-10 ». Pourquoi ce mot de passe, qui contient pourtant 13 caractères, une majuscule, des tirets et un chiffre, est-il considéré comme faible par n’importe quel spécialiste cyber ?

Parce qu’il est prévisible. Et en théorie de l’information, « prévisible » veut dire « faible entropie ». Cette théorie a démontré que la robustesse d’un secret ne se mesure pas au nombre de caractères ni à la présence de symboles bizarres. Elle se mesure à la quantité d’incertitude qu’un attaquant doit lever pour le deviner. Un mot de passe qui contient le nom de votre chien, un mot du dictionnaire, une date anniversaire ou un pattern évident (Du-10, -!, 123…) offre à un attaquant un dictionnaire beaucoup plus petit à explorer que ce que sa longueur laisse croire. Et ce dictionnaire, il n’a même pas besoin de le construire à la main. Le nom de votre chien est sur votre profil Instagram, votre département dans votre bio LinkedIn, votre date de naissance sur Facebook. Des outils librement accessibles permettent de collecter ces informations et de générer automatiquement des milliers de combinaisons probables en quelques secondes. Votre mot de passe « personnel » ne l’est déjà plus.

C’est ce constat qui a conduit le NIST à revoir complètement ses règles. Le NIST (National Institute of Standards and Technology) est l’organisme fédéral américain qui définit les standards technologiques et de sécurité, et ses recommandations servent de référence à de nombreuses entreprises et institutions à travers le monde. Or dans son guide SP 800-63B, le NIST a fait un virage à 180 degrés. Exit les caractères spéciaux obligatoires, exit le renouvellement tous les 90 jours. Place à la longueur, à l’aléatoire réel, et à la vérification contre les listes de mots de passe déjà fuités.

Concrètement, le NIST recommande une passphrase composée de mots tirés aléatoirement, mélangés à quelques chiffres insérés au hasard, par exemple tracteur-9-volcan-banque-41-hiver. Six mots sans lien logique, deux chiffres placés aléatoirement : impossible à deviner, et facile à retenir.

Pour un mot de passe composé de L caractères tirés d’un alphabet de N symboles, l’entropie maximale théorique s’écrit : H = L × log₂(N) (en bits). Un mot de passe de 8 caractères purement aléatoires sur 95 symboles imprimables atteint environ 52 bits d’entropie. Une passphrase de 6 mots tirés aléatoirement dans un dictionnaire de 7 776 mots atteint environ 77 bits. La différence paraît modeste. Elle ne l’est pas : chaque bit d’entropie supplémentaire double le travail d’un attaquant. Passer de 52 à 77 bits, c’est multiplier le nombre de combinaisons à tester par plus de 33 millions.

L’implication pour un dirigeant est concrète : une politique de mots de passe efficace n’impose pas des caractères spéciaux tordus qui poussent vos collaborateurs à écrire leurs secrets sur un post-it. Elle impose de la longueur, de l’aléatoire véritable, et un gestionnaire de mots de passe pour retenir tout ça. Elle se double d’une authentification multi-facteurs, qui ajoute mécaniquement de l’entropie à l’équation. C’est tout le sens de la démarche que nous accompagnons dans les enjeux de la cybersécurité pour les PME : moins de théâtre, plus de maths.

Vos images : l’entropie comme plafond de compression

Deuxième application, deuxième angle. Quand vous publiez une photo sur votre site e-commerce, un visuel sur Instagram ou une bannière dans une newsletter, cette image est compressée. PNG, JPEG, WebP, AVIF : chacun de ces formats est un algorithme qui cherche à réduire le poids du fichier. Mais tous ne jouent pas le même jeu, et dans les deux cas, c’est encore Shannon qui fixe les règles.

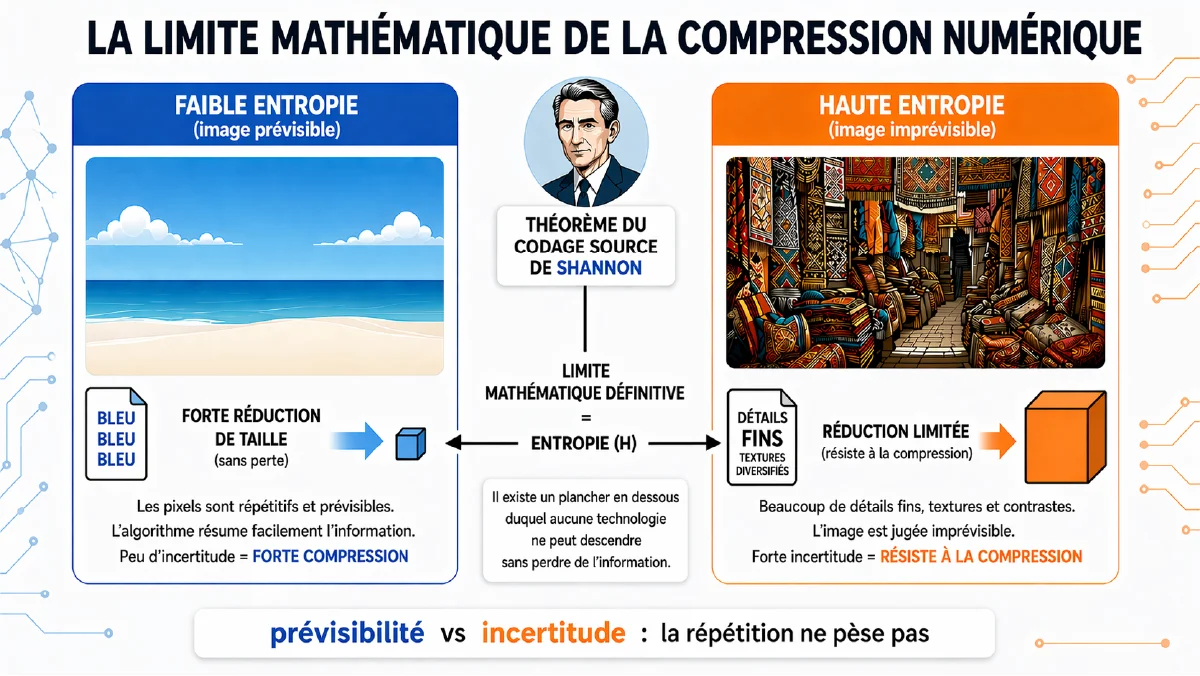

Il faut en effet distinguer deux familles. La compression sans perte (PNG, certains modes de WebP) garantit que vous retrouverez à l’ouverture exactement les mêmes pixels qu’à l’enregistrement. Pas un seul n’est modifié. C’est la famille « coffre-fort » : tout ce qui entre ressort à l’identique. Le problème, c’est que Shannon a posé une limite absolue à ce type de compression : on ne peut pas compresser un signal sans perte en dessous de son entropie. C’est son théorème du codage source. Ce n’est pas un plafond technique qu’on finira par dépasser avec un meilleur algorithme : une limite physique, mathématique, définitive. Si votre image contient beaucoup d’incertitude (beaucoup de détails fins, de textures, de contrastes), elle résiste à la compression. Si elle est très prévisible (un grand ciel bleu uniforme, un fond blanc), elle se compresse formidablement. Mais dans tous les cas, il existe un plancher en dessous duquel aucune technologie ne descendra jamais sans perdre de l’information.

C’est précisément là qu’intervient la seconde famille : la compression avec perte (JPEG, AVIF, WebP « lossy », et la quasi-totalité des formats utilisés sur le web). Son principe est radicalement différent. Au lieu de conserver chaque pixel à l’identique, elle analyse l’image, identifie les variations auxquelles l’œil humain est peu sensible (certaines nuances de couleur, des transitions subtiles de luminosité, des détails de très haute fréquence) et les efface volontairement. Le fichier devient plus léger parce qu’il contient littéralement moins d’information que l’original. C’est un choix assumé : on troque la fidélité contre du poids. Et là encore, Shannon a tracé la courbe théorique du meilleur compromis possible entre qualité et poids, à travers sa théorie du débit-distorsion, qu’il a lui-même fondée. AVIF et WebP font mieux que JPEG, grâce à des algorithmes plus malins. Mais aucun ne « bat » Shannon : ils se déplacent sur la courbe qu’il a tracée, et c’est vous qui décidez du curseur.

C’est pour ça qu’une même photo peut peser 3 Mo en PNG (sans perte, fidélité totale) et 150 Ko en JPEG (avec perte, qualité visuelle pratiquement équivalente). La différence, c’est l’information qu’on a accepté de jeter. Et ce choix a des conséquences business directes. Un site lent pénalise votre SEO, votre UX, votre taux de conversion, et votre facture serveur. Les images représentent souvent 60 à 80 % du poids d’une page web moderne. Bien les optimiser, ce n’est pas choisir « PNG ou JPEG » à la légère : c’est comprendre qu’il existe un plancher mathématique (l’entropie), que la compression sans perte ne descendra jamais en dessous, et que les vrais gains viennent d’un réglage fin du compromis perte / qualité. Une stratégie, pas un clic. Si le sujet vous parle, nous l’avons creusé dans un article dédié à l’optimisation des images pour votre site.

Voilà deux applications, et on tient déjà la même mécanique sous le capot. Passons à la troisième, celle qui boucle la boucle.

Claude et l’IA : l’entropie comme moteur de décision

Vous utilisez peut-être Claude au quotidien. Pour écrire, pour coder, pour brainstormer. L’entreprise qui l’édite, Anthropic, a choisi ce prénom en hommage explicite à Claude Shannon. Ce n’est pas une coquetterie marketing : c’est une filiation intellectuelle assumée, largement documentée par Wikipedia, Britannica ou le Boston Globe. Le père de la théorie de l’information donne son prénom à l’une des IA les plus avancées de l’époque. Logique, puisque sans lui, il n’y aurait tout simplement pas d’IA moderne.

Pourquoi ? Parce que toute l’IA actuelle est construite sur son concept d’entropie. Quelques exemples très concrets :

- Les arbres de décision (Random Forest, XGBoost), qui font tourner beaucoup de modèles de scoring, de détection de fraude, de recommandation produits, choisissent leurs branches en maximisant le gain d’information. Traduction : à chaque étape, l’algorithme sélectionne la question qui fait le plus baisser l’entropie du groupe. Pur Shannon.

- Les grands modèles de langage comme Claude, ChatGPT ou Gemini sont entraînés en minimisant une fonction de perte appelée cross-entropy, une extension directe de l’entropie shannonienne à la comparaison entre distributions de probabilités.

- La fameuse température que l’on peut régler sur un LLM (0 pour des réponses déterministes, 1 pour des réponses créatives) est littéralement un paramètre qui module l’entropie de la distribution de sortie. Vous faites du Shannon à chaque fois que vous cochez une case « mode créatif ».

L’implication pour un dirigeant est inattendue : quand vous déléguez une tâche à une IA, vous ne « parlez pas à un robot ». Vous exploitez, à travers une interface conversationnelle, une mécanique d’entropie conditionnelle qui construit sa réponse token par token, chacun choisi en fonction de tout ce qui précède. Le prompt est le point d’entrée de cette mécanique. Plus il est précis, plus vous réduisez l’incertitude à la source, plus la sortie est pertinente. Ce n’est pas un hasard si le prompt engineering est devenu un métier. Pour creuser cet angle, nous avons rédigé un guide dédié à comprendre le prompt engineering.

Un concept, trois leviers business

Pour remettre les pièces du puzzle ensemble :

| Domaine | Ce que mesure l’entropie | Ce que ça change pour vous |

| Mot de passe | L’imprévisibilité du secret | Politique MDP fondée sur la longueur et l’aléatoire, pas sur les caractères spéciaux. MFA systématique. Gestionnaire de mots de passe. |

| Image | La quantité d’information visuelle irréductible | Choix du bon format (WebP / AVIF), compromis qualité / poids, impact direct sur SEO, UX et coût serveur. |

| IA (Claude, LLM, ML) | L’incertitude résiduelle d’une prédiction | Prompts précis pour réduire l’entropie à la source, choix de la température selon l’usage, compréhension du fonctionnement réel des modèles. |

Trois territoires métier que l’on traite souvent en silos dans une PME : la cyber d’un côté, le site web de l’autre, l’IA encore ailleurs. Shannon démontre qu’ils partagent exactement le même langage mathématique. Ce qui explique pourquoi ils méritent d’être traités ensemble, par un partenaire qui voit la cohérence derrière les étiquettes.

Ce que Shannon change dans votre stratégie digitale

Shannon a écrit son papier fondateur en 1948. Depuis, son entropie sous-tend tout : vos mots de passe, vos photos, vos prompts. Elle est le socle caché de la cyber, du web, de l’IA et bien plus encore. Et pourtant, la plupart des agences vendent ces trois territoires comme s’ils n’avaient rien à voir entre eux.

Chez Zetruc, nous partons du principe que le digital est un tout. Une politique de mots de passe mal calibrée fragilise votre site, qui ralentit à cause d’images mal compressées, pendant que vos équipes utilisent des prompts IA approximatifs qui produisent des contenus médiocres. Chacun de ces trois maux se soigne avec la même grammaire, celle que Shannon a posée. Notre métier, depuis 20 ans, c’est de vous aider à la parler correctement, sur les trois territoires en même temps.

Si ce fil rouge Shannon vous a donné envie d’en discuter avec nos équipes, ou si vous voulez aller plus loin sur l’usage concret des grands modèles au sein de votre entreprise avec notre formation à l’intelligence artificielle, on prend rendez-vous quand vous voulez.